OpenAI เปิดตัว GPT-4o ซึ่งเป็นโมเดลภาษาหลายโหมดขนาดใหญ่ที่รองรับการสนทนาแบบเรียลไทม์ คำถามและคำตอบ การสร้างข้อความ และอื่นๆ อีกมากมาย

OpenAI เป็นหนึ่งในผู้จำหน่ายที่สร้างรูปลักษณ์ใหม่ให้กับยุคGenerative AIรากฐานสำหรับความสำเร็จและความนิยมของ OpenAI คือตระกูล GPT ของโมเดลภาษาขนาดใหญ่ (LLM) ของบริษัท รวมถึง GPT-3 และ GPT-4 ควบคู่ไปกับ บริการ ChatGPT ของ AI เชิงสนทนา ของบริษัท

OpenAI ประกาศเปิดตัว GPT-4 Omni (GPT-4o) ในฐานะโมเดลภาษามัลติโหมดเรือธงใหม่ของบริษัท เมื่อวันที่ 13 พฤษภาคม 2024 ในงาน Spring Updates ของบริษัท ในฐานะส่วนหนึ่งของงานนี้ OpenAI ได้เผยแพร่คลิปวิดีโอหลายรายการที่สาธิตความสามารถในการตอบสนองด้วยเสียงและการแสดงผลของโมเดล

ในเดือนกรกฎาคม ปี 2024 OpenAI ได้เปิดตัว GPT-4o เวอร์ชันเล็ก — GPT-4o mini นี่เป็นรุ่นเล็กที่ล้ำหน้าที่สุดของบริษัท

GPT-4o คืออะไร?

GPT-4o เป็นโมเดลเรือธงในพอร์ตโฟลิโอเทคโนโลยี LLM ของ OpenAI O ย่อมาจาก Omni และไม่ใช่เป็นเพียงรูปแบบหนึ่งของการโฆษณาชวนเชื่อทางการตลาด แต่ยังหมายถึงรูปแบบต่างๆ ของโมเดลสำหรับข้อความ รูปภาพ และเสียงอีกด้วย

โมเดล GPT-4o ถือเป็นวิวัฒนาการใหม่ของ GPT-4 LLM ที่ OpenAI เปิดตัวครั้งแรกในเดือนมีนาคม 2023 นี่ไม่ใช่การอัปเดตครั้งแรกของ GPT-4 เนื่องจากโมเดลนี้เปิดตัวครั้งแรกในเดือนพฤศจิกายน 2023 ด้วยการเปิดตัว GPT-4 Turbo คำย่อ GPT ย่อมาจาก Generative Pre-Trained Transformer โมเดลหม้อแปลงเป็นองค์ประกอบพื้นฐานของ Generative AI โดยให้สถาปัตยกรรมเครือข่ายประสาทที่สามารถทำความเข้าใจและสร้างเอาต์พุตใหม่ๆ ได้

GPT-4o เหนือกว่าสิ่งที่ GPT-4 Turbo นำเสนอทั้งในด้านความสามารถและประสิทธิภาพ เช่นเดียวกับ GPT-4 รุ่นก่อน GPT-4o สามารถนำมาใช้สำหรับกรณีที่จำเป็นต้องสร้างข้อความ เช่น บทสรุป คำถามและคำตอบแบบอิงความรู้ โมเดลนี้ยังมีความสามารถในการใช้เหตุผล แก้ไขปัญหาที่ซับซ้อนและการเขียนโปรแกรมอีกด้วย

รุ่น GPT-4o นำเสนอการตอบสนองที่รวดเร็วต่ออินพุตเสียง ซึ่งตาม OpenAI ระบุว่ามีความคล้ายคลึงกับมนุษย์ โดยมีเวลาตอบสนองเฉลี่ย 320 มิลลิวินาที นอกจากนี้ โมเดลยังสามารถตอบสนองด้วยเสียงที่สร้างโดย AI ที่ฟังดูคล้ายมนุษย์ได้อีกด้วย

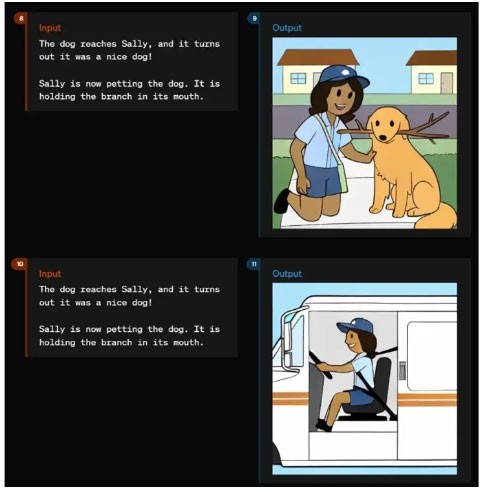

แทนที่จะมีโมเดลแยกต่างหากที่เข้าใจเสียง ภาพ ซึ่ง OpenAI เรียกว่าวิสัยทัศน์ และข้อความ GPT-4o จะรวมลักษณะเหล่านั้นเข้าเป็นโมเดลเดียว ดังนั้น GPT-4o จึงสามารถเข้าใจการผสมผสานระหว่างข้อความ รูปภาพ และเสียงที่ป้อน และตอบสนองด้วยเอาต์พุตในรูปแบบใดๆ เหล่านั้นได้

คำมั่นสัญญาของ GPT-4o และความสามารถในการตอบรับแบบมัลติโหมดเสียงความเร็วสูงคือการทำให้โมเดลนี้สามารถโต้ตอบกับผู้ใช้ได้อย่างเป็นธรรมชาติและใช้งานง่ายยิ่งขึ้น

GPT-4o mini เป็นโมเดลที่เร็วที่สุดของ OpenAI และเปิดใช้งานแอปพลิเคชันด้วยต้นทุนต่ำ GPT-4o mini มีความฉลาดกว่า GPT-3.5 Turbo และมีราคาถูกกว่า 60% ข้อมูลการฝึกอบรมจะมีไปจนถึงเดือนตุลาคม 2023 GPT-4o mini พร้อมใช้งานในรูปแบบข้อความและวิสัยทัศน์สำหรับนักพัฒนาผ่าน Assistants API, Chat Completions API และ Batch API เวอร์ชันมินิยังมีให้บริการบน ChatGPT, Free, Plus และ Team สำหรับผู้ใช้อีกด้วย

GPT-4o ทำอะไรได้บ้าง?

ณ เวลาที่เปิดตัว GPT-4o ถือเป็นโมเดล OpenAI ที่มีความสามารถสูงสุดในแง่ของทั้งฟังก์ชันการทำงานและประสิทธิภาพการทำงาน

GPT-4o สามารถทำได้หลายอย่าง เช่น:

- การโต้ตอบแบบเรียลไทม์ โมเดล GPT-4o สามารถมีส่วนร่วมในการสนทนาทางวาจาแบบเรียลไทม์ได้โดยไม่เกิดความล่าช้าที่สังเกตเห็นได้

- ถาม-ตอบแบบอิงความรู้ เช่นเดียวกับโมเดล GPT-4 รุ่นก่อนๆ GPT-4o ได้รับการฝึกอบรมโดยใช้ฐานความรู้และสามารถตอบคำถามได้

- สรุปและสร้างข้อความ เช่นเดียวกับโมเดล GPT-4 รุ่นก่อนๆ ทั้งหมด GPT-4o สามารถทำงาน LLM ข้อความทั่วไปได้ รวมถึงการสรุปและสร้างข้อความ

- การใช้เหตุผลและการสร้างแบบหลายโหมด GPT-4o บูรณาการข้อความ คำพูด และรูปภาพเป็นโมเดลเดียว ช่วยให้สามารถประมวลผลและตอบสนองประเภทข้อมูลร่วมกันได้ โมเดลสามารถเข้าใจเสียง ภาพ และข้อความด้วยความเร็วเดียวกัน นอกจากนี้ยังสามารถสร้างผลตอบรับผ่านเสียง ภาพ และข้อความได้อีกด้วย

- การประมวลผลภาษาและเสียง GPT-4o มีความสามารถขั้นสูงในการจัดการภาษาต่างๆ มากกว่า 50 ภาษา

- การวิเคราะห์ความรู้สึก โมเดลนี้เข้าใจความรู้สึกของผู้ใช้ผ่านข้อความ เสียง และวิดีโอรูปแบบต่างๆ

- น้ำเสียง GPT-4o สามารถสร้างเสียงที่มีอารมณ์ละเอียดอ่อนได้ ซึ่งทำให้มีประสิทธิภาพสำหรับแอปพลิเคชั่นที่ต้องการการสื่อสารที่ละเอียดอ่อนและมีรายละเอียด

- การวิเคราะห์เนื้อหาเสียงโมเดลสามารถสร้างและเข้าใจภาษาพูด ซึ่งสามารถนำไปใช้ในระบบที่สั่งงานด้วยเสียง การวิเคราะห์เนื้อหาเสียง และการเล่าเรื่องแบบโต้ตอบได้

- การแปลแบบเรียลไทม์ความสามารถมัลติโหมดของ GPT-4o สามารถรองรับการแปลแบบเรียลไทม์จากภาษาหนึ่งเป็นอีกภาษาหนึ่งได้

- เข้าใจภาพและวีดีโอโมเดลนี้สามารถวิเคราะห์ภาพและวิดีโอ ทำให้ผู้ใช้สามารถอัปโหลดเนื้อหาวิดีโอที่ GPT-4o เข้าใจ ตีความ และวิเคราะห์ได้

- การวิเคราะห์ข้อมูล . ความสามารถในการใช้เหตุผลและการมองเห็นช่วยให้ผู้ใช้สามารถวิเคราะห์ข้อมูลที่มีอยู่ในแผนภูมิข้อมูลได้ GPT-4o ยังสามารถสร้างแผนภูมิข้อมูลตามการวิเคราะห์หรือคำเตือนได้อีกด้วย

- อัพโหลดไฟล์นอกเหนือจากเกณฑ์ความรู้แล้ว GPT-4o ยังรองรับการอัปโหลดไฟล์ ซึ่งช่วยให้ผู้ใช้สามารถจัดเตรียมข้อมูลที่เฉพาะเจาะจงเพื่อการวิเคราะห์ได้

- ความตระหนักรู้และความจำบริบท GPT-4o สามารถจดจำการโต้ตอบก่อนหน้าและรักษาบริบทในการสนทนาที่ยาวนานได้

- หน้าต่างบริบทขนาดใหญ่ ด้วยหน้าต่างบริบทที่รองรับโทเค็นได้สูงสุดถึง 128,000 โทเค็น GPT-4o สามารถรักษาความสอดคล้องระหว่างบทสนทนาหรือเอกสารยาวๆ ทำให้เหมาะสำหรับการวิเคราะห์โดยละเอียด

- ลดอาการประสาทหลอน และเพิ่มความปลอดภัย โมเดลนี้ได้รับการออกแบบมาเพื่อลดการสร้างข้อมูลที่ไม่ถูกต้องหรือทำให้เข้าใจผิด GPT-4o มีโปรโตคอลการรักษาความปลอดภัยขั้นสูงเพื่อรับรองผลลัพธ์ที่สม่ำเสมอและปลอดภัยสำหรับผู้ใช้

วิธีการใช้งาน GPT-4o

ผู้ใช้และองค์กรสา��ารถใช้ GPT-4o ได้หลายวิธี

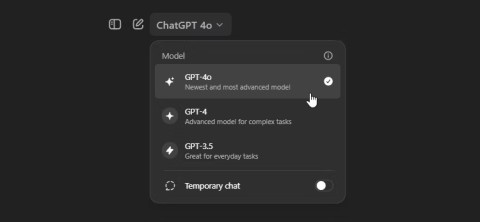

- ChatGPT นั้นฟรีมีการเตรียมโมเดล GPT-4o ให้ใช้งานได้ฟรีแก่ผู้ใช้แชทบอท ChatGPT ของ OpenAI เมื่อพร้อมใช้งาน GPT-4o จะแทนที่ค่าเริ่มต้นปัจจุบันสำหรับผู้ใช้ ChatGPT ฟรี ผู้ใช้ ChatGPT ฟรีจะมีการเข้าถึงข้อความแบบจำกัด และจะไม่สามารถเข้าถึงฟีเจอร์ขั้นสูงบางประการได้ รวมถึงการอัปโหลดไฟล์และการวิเคราะห์ข้อมูล

- ChatGPT Plus . ผู้ใช้บริการแบบชำระเงินของ OpenAI สำหรับ ChatGPT จะได้รับสิทธิ์เข้าถึง GPT-4o อย่างเต็มรูปแบบ โดยไม่มีข้อจำกัดด้านฟีเจอร์ที่ผู้ใช้ฟรีสามารถใช้งานได้

- การ เข้าถึงAPIนักพัฒนาสามารถเข้าถึง GPT-4o ได้ผ่านทาง API ของ OpenAI ซึ่งจะทำให้สามารถบูรณาการเข้ากับแอปพลิเคชันเพื่อใช้ประโยชน์จากความสามารถของ GPT-4o สำหรับงานต่างๆ ได้อย่างเต็มที่

- แอพพลิเคชันเดสก์ท็อป OpenAI ได้รวม GPT-4o ไว้ในแอปพลิเคชันเดสก์ท็อป รวมถึงแอปใหม่สำหรับ macOS ของ Apple ที่เปิดตัวเมื่อวันที่ 13 พฤษภาคมเช่นกัน

- GPT ที่กำหนดเององค์กรต่างๆ สามารถสร้าง GPT-4o เวอร์ชันที่กำหนดเองเพื่อให้เหมาะกับความต้องการเฉพาะของธุรกิจหรือแผนกต่างๆ ได้ ผู้ใช้มีแนวโน้มที่จะสามารถใช้โมเดลที่กำหนดเองได้ผ่าน GPT Store ของ OpenAI

- บริการ Microsoft OpenAIผู้ใช้สามารถสำรวจขีดความสามารถของ GPT-4o ในโหมดดูตัวอย่างใน Microsoft Azure OpenAI Studio ซึ่งได้รับการออกแบบโดยเฉพาะเพื่อจัดการอินพุตหลายโหมดรวมทั้งข้อความและการมองเห็น การเปิดตัวเบื้องต้นนี้จะช่วยให้ลูกค้า Azure OpenAI Service สามารถทดลองใช้ความสามารถของ GPT-4o ในสภาพแวดล้อมที่มีการควบคุม โดยมีแผนที่จะขยายความสามารถในอนาคต

นอกจากนี้ผู้อ่านยังสามารถอ้างอิง: ความแตกต่างระหว่าง GPT-4, GPT-4 Turbo และ GPT- 4o