ในช่วงต้นเดือนเมษายน พ.ศ. 2568 Meta ได้เปิดตัว Llama 4ซึ่งเป็นซีรีส์โมเดล AI ล่าสุดที่ออกแบบมาเพื่อพาบริษัทสู่ระดับต่อไป Llama 4 ใหม่แต่ละรุ่นมีการปรับปรุงที่สำคัญเมื่อเทียบกับรุ่นก่อนๆ และนี่คือคุณลักษณะใหม่ที่โดดเด่นที่คุณควรลองใช้

3. สถาปัตยกรรมแบบผสมผสานของผู้เชี่ยวชาญ (MoE)

คุณลักษณะที่โดดเด่นที่สุดอย่างหนึ่งของโมเดล Llama 4 คือสถาปัตยกรรม MoE ใหม่ ซึ่งถือเป็นครั้งแรกของซีรีส์ Llama ที่ใช้แนวทางที่แตกต่างจากรุ่นก่อนหน้า ในสถาปัตยกรรมใหม่ มีเพียงส่วนเล็กๆ ของพารามิเตอร์โมเดลเท่านั้นที่เปิดใช้งานสำหรับแต่ละโทเค็น ซึ่งแตกต่างจากโมเดลหม้อแปลงหนาแน่นแบบดั้งเดิมเช่น Llama 3 และด้านล่าง ที่พารามิเตอร์ทั้งหมดจะถูกเปิดใช้งานสำหรับแต่ละงาน

ตัวอย่างเช่น Llama 4 Maverick ใช้พารามิเตอร์ที่ใช้งานอยู่เพียง 17 พันล้านรายการจากทั้งหมด 400 พันล้านรายการ โดยมีผู้เชี่ยวชาญที่ถูกส่งไป 128 รายและผู้เชี่ยวชาญที่ใช้ร่วมกัน 1 ราย Llama 4 Scout ซึ่งเป็นตัวที่เล็กที่สุดในซีรีย์นี้มีพารามิเตอร์ทั้งหมด 109 พันล้านตัว โดยเปิดใช้งานเพียง 17 พันล้านตัวด้วยผู้เชี่ยวชาญ 16 คน

Llama 4 Behemoth ซึ่งเป็นเวอร์ชันที่ใหญ่ที่สุดของกลุ่มสามตัวนี้ ใช้พารามิเตอร์ที่ใช้งานอยู่ 288 พันล้านรายการ (โดยมีผู้เชี่ยวชาญ 16 คน) จากพารามิเตอร์ทั้งหมดเกือบสองล้านล้านรายการ ด้วยสถาปัตยกรรมใหม่นี้ จึงทำให้มีผู้เชี่ยวชาญเพียง 2 คนที่ได้รับมอบหมายให้ดูแลงานแต่ละงานเท่านั้น

ด้วยการเปลี่ยนแปลงทางสถาปัตยกรรม ทำให้โมเดลในซีรีย์ Llama 4 มีประสิทธิภาพในการคำนวณมากขึ้นในระหว่างการฝึกและการอนุมาน การเปิดใช้งานเพียงพารามิเตอร์ส่วนเล็กน้อยจะช่วยลดต้นทุนบริการและเวลาแฝง ด้วยสถาปัตยกรรม MoE ทาง Meta จึงอ้างว่า Llama สามารถทำงานบน GPU Nvidia H100 ตัวเดียวได้ ซึ่งถือเป็นความสำเร็จที่น่าประทับใจเมื่อพิจารณาจากจำนวนพารามิเตอร์ แม้ว่าจะไม่มีหน่วยวัดที่เจาะจง แต่เชื่อกันว่าการค้นหาในChatGPT แต่ละครั้ง จะใช้ GPU Nvidia หลายตัว ซึ่งทำให้เกิดค่าใช้จ่ายคงที่ที่มากขึ้นในหน่วยวัดที่วัดได้เกือบทุกหน่วย

2. ความสามารถในการประมวลผลแบบมัลติโหมดดั้งเดิม

การอัพเดตสำคัญอีกประการหนึ่งสำหรับโมเดล AI Llama 4 ก็คือการประมวลผลมัลติโหมดดั้งเดิม ซึ่งหมายความว่าทั้งสามตัวสามารถเข้าใจข้อความและรูปภาพได้พร้อมกัน

ซึ่งเป็นผลมาจากการผสมผสานที่ดำเนินการในระยะการฝึกเริ่มต้น โดยที่ข้อความและโทเค็นภาพจะถูกรวมเข้าไว้ในสถาปัตยกรรมแบบรวมศูนย์ โมเดลได้รับการฝึกอบรมโดยใช้ข้อมูลข้อความ รูปภาพ และวิดีโอที่ไม่มีป้ายกำกับจำนวนมาก

ไม่มีอะไรจะดีไปกว่านี้อีกแล้ว หากคุณจำได้ การอัปเกรดLlama 3.2 ของ Meta ซึ่งเปิดตัวในเดือนกันยายน 2024 ได้เปิดตัวโมเดลใหม่ๆ จำนวนมาก (รวมทั้งหมด 10 โมเดล) รวมถึงโมเดลวิสัยทัศน์มัลติโหมด 5 โมเดลและโมเดลข้อความ 5 โมเดล ด้วยเจเนอเรชันนี้ บริษัทไม่จำเป็นต้องออกโมเดลข้อความและวิสัยทัศน์แยกต่างหากอีกต่อไป เนื่องจากมีความสามารถในการประมวลผลมัลติโหมดดั้งเดิม

นอกจากนี้ Llama 4 ยังใช้ตัวเข้ารหัสภาพที่ได้รับการปรับปรุงใหม่ ซึ่งช่วยให้โมเดลสามารถจัดการงานอนุมานภาพที่ซับซ้อนและอินพุตหลายภาพได้ ทำให้สามารถจัดการแอปพลิเคชันที่ต้องมีความเข้าใจขั้นสูงเกี่ยวกับข้อความและรูปภาพได้ การประมวลผลแบบหลายโหมดยังช่วยให้สามารถใช้โมเดล LLama 4 ได้ในแอปพลิเคชันที่หลากหลายอีกด้วย

1. หน้าต่างบริบทชั้นนำของอุตสาหกรรม

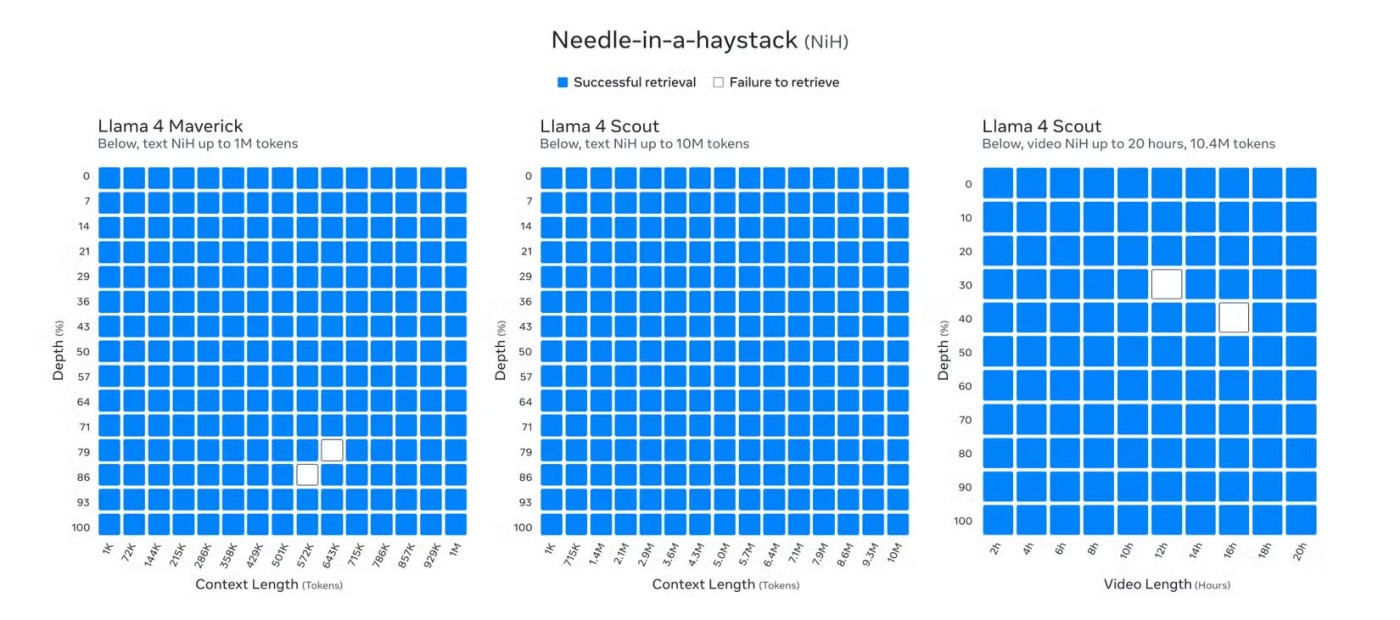

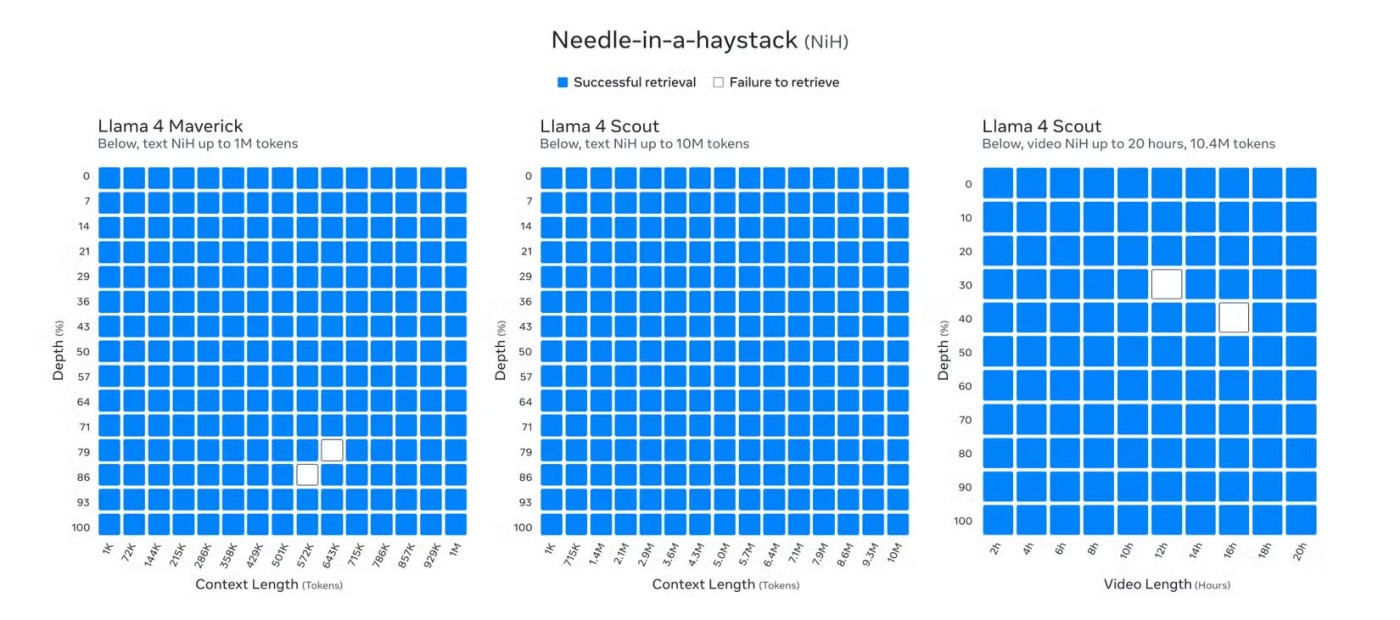

โมเดล AI ของ Llama 4 มีหน้าต่างบริบทที่ไม่เคยมีมาก่อนมากถึง 10 ล้านโทเค็น ในขณะที่ Llama 4 Behemoth ยังคงอยู่ในระหว่างการพัฒนาในขณะที่เผยแพร่ Llama 4 Scout ได้สร้างมาตรฐานอุตสาหกรรมใหม่ด้วยความสามารถในการรองรับโทเค็นได้สูงสุดถึง 10 ล้านโทเค็นในความยาวบริบท ซึ่งทำให้คุณสามารถป้อนข้อความที่มีความยาวมากกว่า 5 ล้านคำได้

ความยาวบริบทที่ขยายนี้เพิ่มขึ้นอย่างมีนัยสำคัญจากโทเค็น 8,000 ของ Llama 3 เมื่อเปิดตัวครั้งแรกและแม้แต่การขยายตามมาเป็น 128,000 หลังจากการอัปเกรด Llama 3.2 และไม่ใช่แค่ความยาวบริบท 10 ล้านของ Llama 4 Scout เท่านั้นที่น่าสนใจ แม้แต่ Llama 4 Maverick ที่มีความยาวถึงหนึ่งล้านบริบทก็ยังถือเป็นความสำเร็จที่น่าประทับใจ

ปัจจุบัน Llama 3.2 เป็นหนึ่งในแชทบอท AI ที่ดีที่สุดสำหรับการสนทนาระยะยาว อย่างไรก็ตาม หน้าต่างบริบทที่ขยายออกของ Llama 4 ทำให้ Llama ขึ้นเป็นผู้นำ โดยแซงหน้าหน้าต่างบริบทโทเค็น 2 ล้านอันดับแรกของ Gemini ก่อนหน้านี้, 200K ของ Claude 3.7 Sonnet และ 128K ของ GPT-4.5

ด้วยหน้าต่างบริบทขนาดใหญ่ ซีรีส์ Llama 4 สามารถจัดการงานที่ต้องการอินพุตที่มีข้อมูลจำนวนมากได้ หน้าต่างขนาดใหญ่มีประโยชน์สำหรับงานต่างๆ เช่น การวิเคราะห์เอกสารหลายฉบับยาวๆ วิเคราะห์ฐานโค้ดขนาดใหญ่โดยละเอียด และการใช้เหตุผลในชุดข้อมูลขนาดใหญ่

นอกจากนี้ยังช่วยให้ Llama 4 สามารถสนทนาแบบยาวได้ ซึ่งแตกต่างจากโมเดล Llama รุ่นก่อนๆ และโมเดลจากบริษัท AI อื่นๆ เหตุผลหนึ่งที่ทำให้ Gemini 2.5 Pro เป็นโมเดลการใช้เหตุผลที่ดีที่สุดคือหน้าต่างบริบทขนาดใหญ่ คุณคงนึกออกว่าหน้าต่างบริบทขนาด 5x หรือ 10x จะทรงพลังขนาดไหน

Llama ซีรีส์ 3 ของ Meta ถือเป็น LLM ที่ดีที่สุดในตลาด แต่ด้วยการเปิดตัวซีรีส์ Llama 4 ทำให้ Meta ก้าวไปอีกขั้นด้วยการไม่เพียงแค่เน้นที่ประสิทธิภาพการอนุมานที่ได้รับการปรับปรุง (ด้วยหน้าต่างบริบทชั้นนำในอุตสาหกรรมใหม่) แต่ยังรวมถึงการประกันถึงโมเดลที่มีประสิทธิภาพสูงสุดเท่าที่จะเป็นไปได้ด้วยการใช้สถาปัตยกรรม MoE ใหม่ในระหว่างการฝึกและการอนุมาน

ความสามารถในการประมวลผลหลายโหมดดั้งเดิมของ Llama 4 สถาปัตยกรรม MoE ที่มีประสิทธิภาพ และหน้าต่างบริบทขนาดใหญ่ทำให้ Llama 4 เป็นโมเดล AI ถ่วงน้ำหนักแบบยืดหยุ่น ประสิทธิภาพสูง ที่เปิดกว้าง ที่สามารถแข่งขันหรือแซงหน้าโมเดลชั้นนำในด้านการอนุมาน การเข้ารหัส และงานอื่นๆ อีกมากมาย