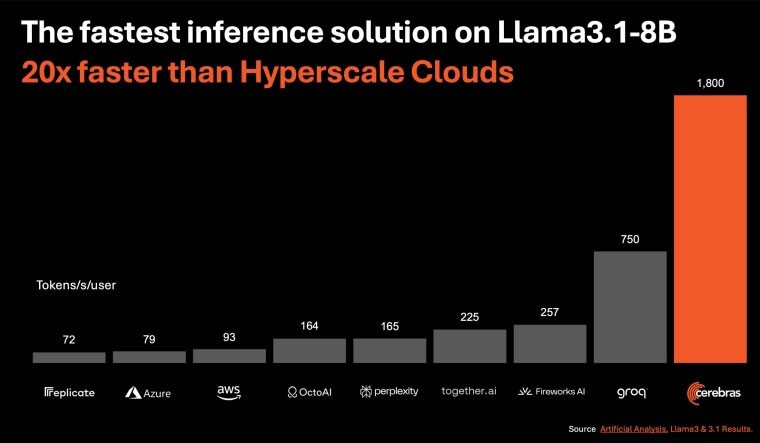

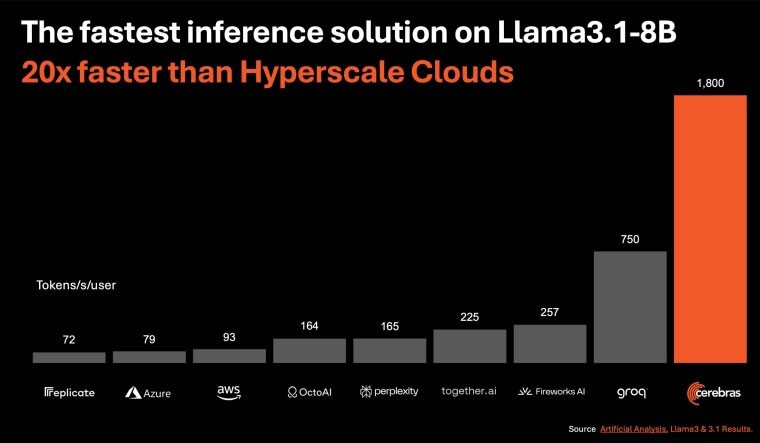

Cerebras Systems เพิ่งประกาศเปิดตัว Cerebras Inference อย่างเป็นทางการ ซึ่งถือเป็นโซลูชันการอนุมาน AI ที่เร็วที่สุดในโลก Cerebras Inference นี้มอบประสิทธิภาพสูงถึง 1,800 โทเค็นต่อวินาทีสำหรับโมเดล Llama 3.1 8B (พารามิเตอร์ 8 พันล้านตัว) และ 450 โทเค็นต่อวินาทีสำหรับ Llama 3.1 70B ซึ่งเร็วกว่าโซลูชันการอนุมาน AI ที่ใช้ GPU ของ NVIDIA เกือบ 20 เท่าที่มีให้ใช้ในระบบคลาวด์ไฮเปอร์สเกลทั่วโลกในปัจจุบัน รวมถึง Microsoft Azure ด้วย

นอกเหนือจากประสิทธิภาพอันน่าเหลือเชื่อแล้ว ราคาบริการของโซลูชั่นอนุมานใหม่นี้ยังมีราคาถูกมากอีกด้วย เป็นเพียงเศษเสี้ยวหนึ่งของราคาแพลตฟอร์มคลาวด์ GPU ยอดนิยม ตัวอย่างเช่น ลูกค้าสามารถรับโทเค็นหนึ่งล้านโทเค็นด้วยราคาเพียง 10 เซ็นต์ ทำให้ประสิทธิภาพด้านราคาสูงขึ้น 100 เท่าสำหรับเวิร์กโหลด AI

ความแม่นยำ 16 บิตและความเร็วในการอนุมานที่เร็วขึ้น 20 เท่าของ Cerebras จะทำให้นักพัฒนาสามารถสร้างแอปพลิเคชัน AI ประสิทธิภาพสูงรุ่นถัดไปได้โดยไม่กระทบต่อความเร็วหรือต้นทุน อัตราส่วนราคา/ประสิทธิภาพที่ก้าวล้ำนี้เป็นไปได้ด้วยระบบ Cerebras CS-3 และโปรเซสเซอร์ AI Wafer Scale Engine 3 (WSE-3) CS-3 ให้แบนด์วิดท์หน่วยความจำมากกว่า Nvidia H100 ถึง 7,000 เท่า ช่วยแก้ปัญหาทางเทคนิคของแบนด์วิดท์หน่วยความจำสำหรับ AI เชิงสร้างสรรค์

ปัจจุบัน Cerebras Inference มีให้เลือกใช้ 3 ระดับดังนี้:

- Free Tier มอบการเข้าถึง API ฟรีและการจำกัดการใช้งานที่ใจดีให้กับทุกคนที่สมัครใช้งาน

- Developer Tier นั้นได้รับการออกแบบมาสำหรับการใช้งานที่ยืดหยุ่นและไม่ต้องใช้เซิร์ฟเวอร์ โดยมอบจุดสิ้นสุดของ API ให้แก่ผู้ใช้ด้วยต้นทุนเพียงเศษเสี้ยวของทางเลือกอื่นๆ ที่มีอยู่ในตลาด โดยที่รุ่น Llama 3.1 8B และ 70B มีราคาเพียง 10 เซ็นต์และ 60 เซ็นต์ต่อหนึ่งล้านโทเค็นตามลำดับ

- แผน Enterprise Tier นำเสนอโมเดลที่ปรับแต่งละเอียด ข้อตกลงระดับบริการแบบกำหนดเอง และการสนับสนุนเฉพาะ เหมาะสำหรับภาระงานต่อเนื่อง ธุรกิจต่างๆ สามารถเข้าถึง Cerebras Inference ได้ผ่านระบบคลาวด์ส่วนตัวที่ Cerebras จัดการหรือภายในองค์กร

ด้วยประสิทธิภาพที่เป็นประวัติการณ์ ราคาที่มีการแข่งขัน และการเข้าถึง API แบบเปิด Cerebras Inference จึงสร้างมาตรฐานใหม่สำหรับการพัฒนาและการปรับใช้ LLM แบบเปิด เนื่องจากเป็นโซลูชั่นเดียวที่สามารถส่งมอบการฝึกอบรมและการอนุมานความเร็วสูง Cerebras จึงเปิดโอกาสใหม่ๆ ให้กับ AI

เนื่องจากแนวโน้ม AI พัฒนารวดเร็วและปัจจุบัน NVIDIA ครองตำแหน่งที่โดดเด่นในตลาด การเกิดขึ้นของบริษัทเช่น Cerebras และ Groq จึงเป็นสัญญาณของการเปลี่ยนแปลงที่อาจเกิดขึ้นในพลวัตของอุตสาหกรรมทั้งหมด เนื่องจากความต้องการโซลูชันการอนุมาน AI ที่รวดเร็วและคุ้มต้นทุนมากขึ้นเพิ่มมากขึ้น โซลูชันเช่น Cerebras Inference จึงอยู่ในตำแหน่งที่ดีในการคว้าโอกาสจากความโดดเด่นของ NVIDIA โดยเฉพาะในพื้นที่ของการอนุมาน